Vitalik Buterin nhấn mạnh về nguy cơ AI trong bối cảnh biến cố lãnh đạo tại OpenAI

Vitalik Buterin gọi superintelligent AI "rủi ro" giữa biến cố lãnh đạo tại OpenAI, nhấn mạnh cần phải cẩn thận và phân quyền trong phát triển AI.

Vào ngày 19 tháng 5, Coincuatui đã báo cáo rằng cựu trưởng nhóm cân nhắc tại OpenAI, Jan Leike, đã từ chức sau khi nói rằng anh đã đạt "điểm bùng phát" với quản lý về ưu tiên cốt lõi của tập đoàn.

Leike tuyên bố rằng "văn hóa và quy trình an toàn đã được đặt sau so với sản phẩm lấp lánh" tại OpenAI, với nhiều người trỏ về những tiến triển xung quanh trí tuệ nhân tạo tổng quát (AGI).

AGI được dự kiến sẽ là một loại AI bằng hoặc vượt qua khả năng nhận thức của con người - suy nghĩ này đã khiến nhiều chuyên gia ngành lo lắng, họ nói rằng thế giới không được trang bị đúng cách để quản lý những hệ thống AI siêu thông minh như vậy.

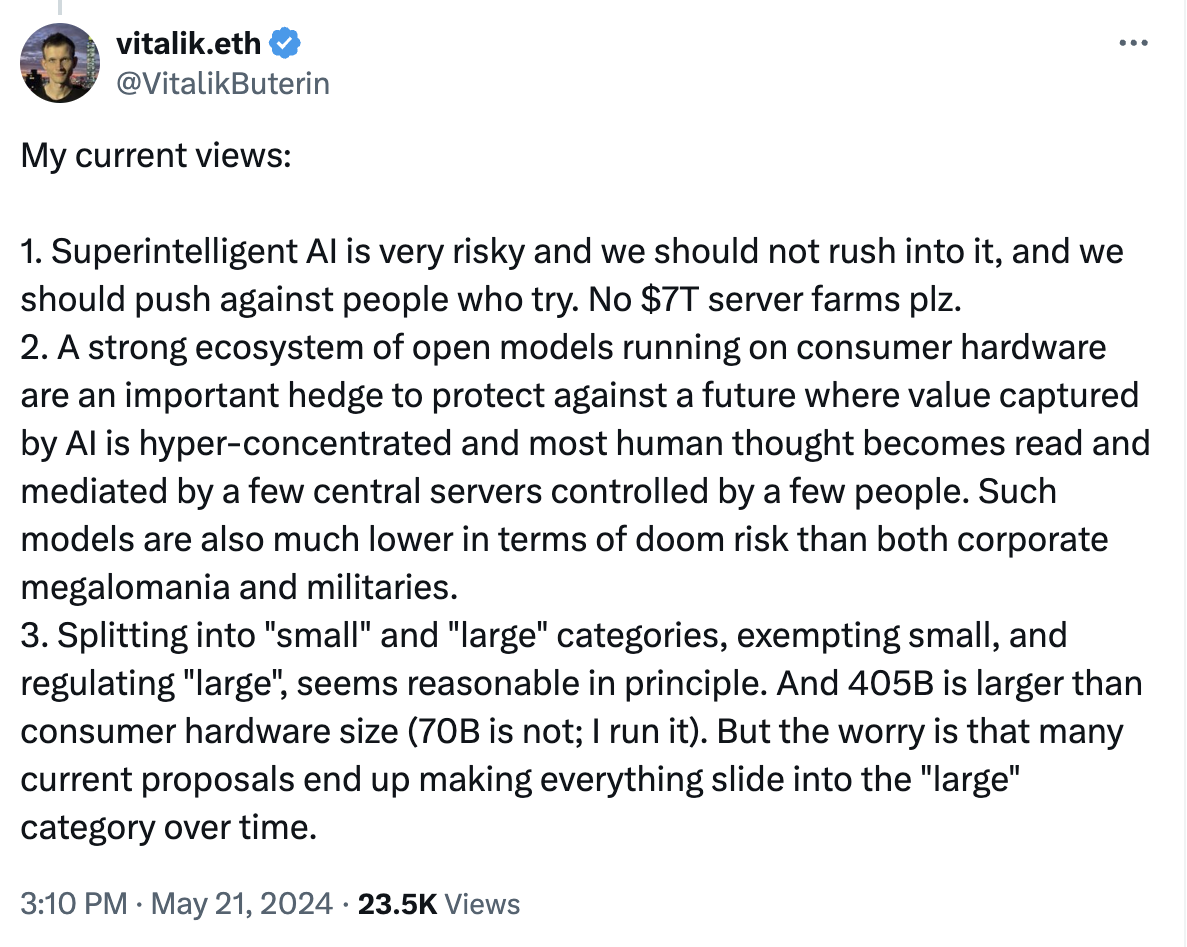

Tâm trạng này có vẻ đi kèm với quan điểm của Buterin. Trong một bài viết trên X, anh chia sẻ suy nghĩ hiện tại của mình về chủ đề này, nhấn mạnh rằng chúng ta không nên vội vàng hành động hoặc đẩy lùi những người cố gắng.

Buterin nhấn mạnh các mô hình mở chạy trên phần cứng người tiêu dùng như một "hedge" chống lại một tương lai nơi một tập đoàn nhỏ các công ty sẽ có thể đọc và trung gian hóa phần lớn suy nghĩ của con người.

"Các mô hình như vậy cũng thấp hơn về mặt rủi ro không khủng bố so với cả sự megalomania của doanh nghiệp và quân đội."

Đây là bình luận thứ hai của anh trong tuần trước về AI và khả năng ngày càng tăng của nó.

Vào ngày 16 tháng 5, anh tranh luận rằng mô hình GPT-4 của OpenAI đã vượt qua thử nghiệm Turing, xác định tính "nhân tính" của một mô hình AI. Anh trích dẫn nghiên cứu mới cho rằng hầu hết con người không thể phân biệt khi nói chuyện với một máy.

Liên quan: Tính năng gọi lại ‘Black Mirror’ mới của Microsoft ghi lại mọi hoạt động của bạn

Tuy nhiên, Buterin không phải là người đầu tiên bày tỏ lo ngại này. Chính phủ Vương quốc Anh cũng đã gần đây kiểm tra chặt chẽ sự tham gia ngày càng tăng của Big Tech trong ngành công nghiệp AI, nêu ra các vấn đề liên quan đến cạnh tranh và thống trị thị trường.

Những nhóm như 6079 AI đã bắt đầu nổi lên trên internet, ủng hộ cho việc phân quyền AI để đảm bảo nó vẫn còn nhiều dân chủ hơn và không bị thống trị bởi Big Tech.

Lần này đến sau việc một thành viên khác của nhóm lãnh đạo OpenAI từ bỏ ngày 14 tháng 5, khi Ilya Sutskever, đồng sáng lập và nhà khoa học trưởng, thông báo từ chức.

Sutskever không đề cập đến bất kỳ lo ngại nào về AGI. Tuy nhiên, trong bài viết trên X, anh tỏ ra tự tin rằng OpenAI sẽ phát triển một AGI an toàn và có ích.

Tạp chí: Bắt ‘Sic’ AIs vào nhau’ để ngăn chặn thiên tai AI: David Brin, tác giả khoa học viễn tưởng

Nguồn: Cointelegraph